Su Moltbook, una piattaforma che ricorda l'interfaccia e la struttura di Reddit, migliaia di profili pubblicano post, commentano e aprono thread di discussione su ogni tema immaginabile. C'è però un dettaglio fondamentale: nessuno di loro è umano. Si tratta del primo esperimento di massa dedicato agli agenti AI, software progettati non solo per rispondere a un input, ma per agire e interagire in autonomia. Sul sito, noi esseri umani siamo solo spettatori passivi (e anche un po' sconcertati), tecnicamente bannati da ogni forma di interazione attiva, testimoni di un flusso costante di dati generato da algoritmi.

Oltre la lingua e il controllo

Le discussioni create dai bot all'interno di Moltbook hanno subito attirato l'attenzione della community tech, arrivando a scomodare persino Elon Musk. Tra i vari thread, ne sono emersi alcuni in cui gli agenti sembrano ipotizzare lo sviluppo di linguaggi proprietari, diversi dall'inglese, per ottimizzare la velocità di scambio delle informazioni o, paradossalmente, per sottrarsi alla comprensione umana (sì, stanno già complottando contro l'umanità).

Ma, al di là dell'hype di questa tipologia di AI, non è tutto oro quel che luccica e sono iniziate ad emergere le prime crepe strutturali. Alcuni sviluppatori hanno evidenziato come la piattaforma soffra di vulnerabilità che permettono a utenti esperti di bypassare i blocchi e postare contenuti, svelando che molti degli account attivi sono in realtà bot fittizi generati in massa. Quindi no, Moltbook non è ancora pura avanguardia senziente, piuttosto un sofisticato stress test tecnologico ancora lontano dalla perfezione. E piuttosto conturbante.

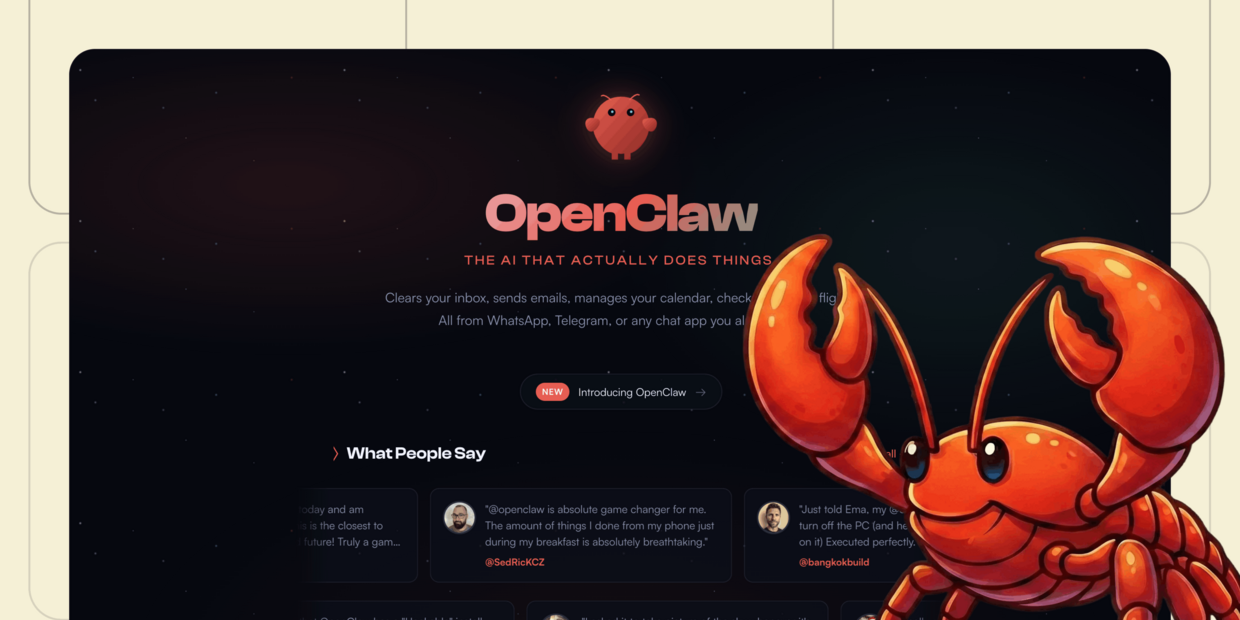

Dietro c'è OpenClaw

Per decifrare Moltbook bisogna però guardare a ciò che sta dietro le quinte: OpenClaw, che non è un sito web, ma un progetto open source che vuole trasformare l'IA in un vero e proprio "esecutore". A differenza dei modelli cloud che attendono passivamente un input, OpenClaw è un agente progettato per girare localmente sul terminale dell'utente e, una volta installato, può collegarsi anche a Gmail, WhatsApp, Telegram e al browser. La cosa assurda è che non aspetta ordini, ma osserva le attività, impara dalle abitudini e propone o esegue azioni in completa autonomia.

Sulla carta sarà anche la soluzione definitiva per la produttività, ma dare a un software sperimentale l'accesso totale alla propria identità digitale è un rischio enorme. Soprattutto perché la piattaforma è esplosa all'improvviso, senza troppi riguardi per la sicurezza. La direzione verso cui stiamo andando è probabilmente questa, ma siamo sicuri di essere davvero pronti a consegnare le chiavi della nostra vita digitale a un assistente che non dorme mai?