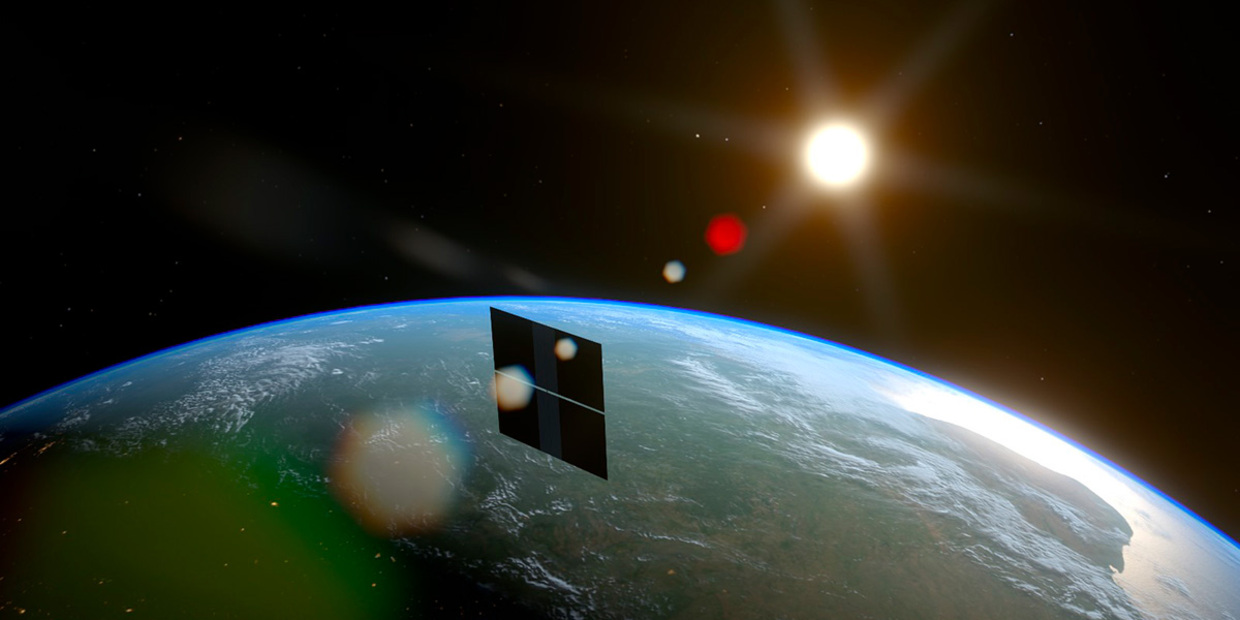

Se le AI factory stanno diventando sempre più voraci di energia, acqua e suolo, c’è chi vuole risolvere il problema "lasciando il pianeta". Starcloud, startup dell’ecosistema Nvidia Inception, lancerà a novembre il suo primo satellite Starcloud-1 con una GPU Nvidia H100: l’obiettivo non è un semplice test tecnico, ma dimostrare che l’inferenza dei modelli si può fare direttamente in orbita, inviando a terra solo gli insight. È il primo tassello di un percorso che guarda a cluster molto più grandi nei prossimi anni.

Perché nello spazio?

L’argomento è energetico e termico. In orbita il solare è quasi continuo e il raffreddamento non si affida all’aria ma all’irraggiamento: grandi radiatori dissipano calore verso il “freddo” dello spazio profondo. Secondo Starcloud, questa combinazione può portare costi energetici fino a 10 volte inferiori rispetto ai data center terrestri e consumo d’acqua nullo per il raffreddamento, con l’idea di spostare parte del carico AI lontano dalle reti a terra e dai vincoli di suolo.

Nel concept di lungo periodo la startup immagina mega-cluster multi-GW con distese chilometriche di pannelli e radiatori modulari, assemblati in orbita. I dettagli ingegneristici sono nel white paper, che affronta la sfida chiave: progettare radiatori leggerissimi ma con area enorme per smaltire gigawatt di calore senza convezione. Qui sta gran parte dell’innovazione richiesta per scalare oltre la singola demo.

La roadmap è serratissima, ma...

C’è anche un pezzo di filiera che si muove. La startup ha annunciato una partnership per portare il proprio cloud a bordo dei satelliti Starcloud, con un primo dispiegamento previsto nel 2026 e capacità limitata dal 2027: un passo verso un "public cloud" in orbita alimentato dal sole. Nvidia, dal canto suo, sostiene Starcloud tramite il programma Inception.

Resta il capitolo connettività e rischi. Per il downlink dei risultati si guarda a collegamenti ottici (laser), già dimostrati dalla NASA con velocità dell’ordine dei Gbps, affiancati da RF come fallback quando il meteo chiude le finestre ottiche.

Sul fronte rischio, collisioni e fine-vita impongono manovrabilità, piani di deorbiting e una governance dello spazio vicino all’altezza dell’ambizione. La domanda è aperta: se i conti energetici dovessero "tenere" davvero, spostare l’AI in orbita potrebbe essere la via più sostenibile. E anche la più ambiziosa.