L’auto sta diventando una questione di architettura, prima ancora che di cavalli o kWh: meno centraline sparse, più calcolo concentrato, più software che si aggiorna e cambia identità nel tempo. Così Qualcomm arriva al CES di Las Vegas con un messaggio semplice e abbastanza ambizioso: il salto verso l'auto del futuro non si fa solo con un infotainment più veloce, ma portando cockpit, ADAS, connettività e nuove funzioni dentro piattaforme di calcolo comuni, con tool e processi simili a quelli dell’elettronica di consumo. Gli annunci di questi giorni (Leapmotor, ZF, Hyundai Mobis e Google), dopotutto, puntano tutti nella stessa direzione.

Dentro l’auto demo al CES la sensazione è stata chiara: il “digital cockpit” non è una bella interfaccia, è potenza di calcolo messa in plancia. Nel nostro giro a bordo, il sistema reggeva grafica spinta e persino gaming con ray tracing senza il classico affanno da infotainment. Più che un effetto wow, è un indizio sempre più definito: l’abitacolo sta diventando sempre più un hub digitale.

Un cervello unico per più domini: il caso Leapmotor

Prendiamo l'annuncio fatto a quattro mani con Leapmotor: un “automotive central computer” che unifica domini finora separati, dal cockpit all’assistenza alla guida, fino a controlli come clima, porte, luci e gateway del veicolo. I due colossi lo presentano come la prima soluzione in produzione di massa basata su una doppia piattaforma Snapdragon Elite (SA8797P), con l’idea di aumentare la potenza disponibile senza moltiplicare i sistemi e la complessità di integrazione. Il primo modello indicato per la produzione è il flagship D19.

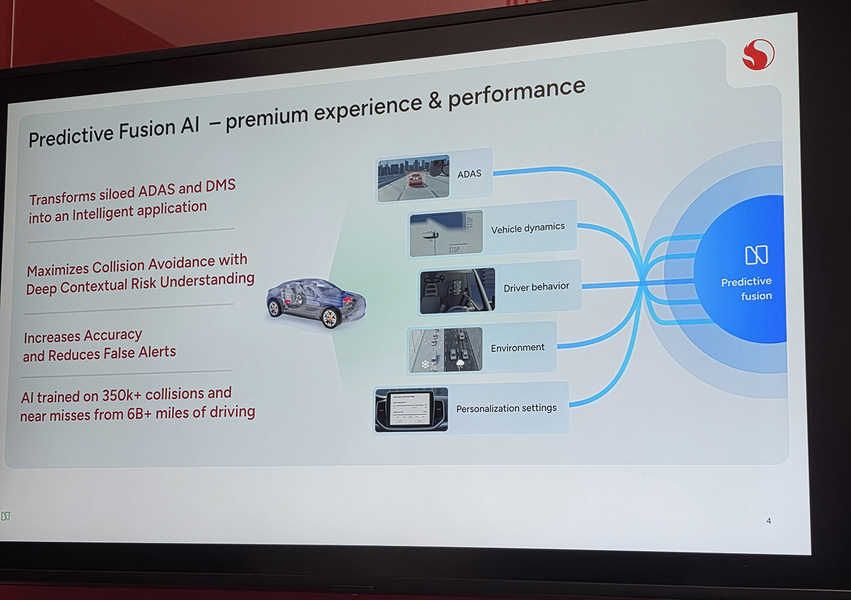

Al di là degli schermi e della grafica (anche se il sistema dichiaratamente regge fino a otto display e audio multi-canale), la notizia è la traiettoria. Consolidare significa ridurre cablaggi, logiche ridondanti, ma anche spostare il valore verso chi controlla la piattaforma e l’ecosistema software, inclusi aggiornamenti OTA e diagnostica remota. Leapmotor e Qualcomm citano anche l’arrivo di “agentic AI” in auto e la possibilità di far convivere modelli diversi tra plancia e guida assistita sfruttando CPU Oryon, GPU Adreno e NPU Hexagon in parallelo. È un modo per dire che l’AI è diventata un carico di lavoro strutturale che influenza l’intera architettura.

ADAS scalabile: ZF e Hyundai Mobis, due strade per lo stesso obiettivo

Sul fronte ADAS, Qualcomm lavora su due questioni figlie della pressione esercitata dal mercato: da una parte la scalabilità su più segmenti, dall’altra la spinta dei Paesi che stanno adottando l’assistenza alla guida a macchia d’olio e non più solo appannaggio delle auto premium.

Con ZF, l’accordo ruota attorno al nuovo "ProAI", presentato come supercomputer automotive capace di fare da controller di dominio, zonale o centrale, e di appoggiarsi alla piattaforma Snapdragon Ride. La promessa è una base aperta su cui integrare software anche di terze parti, con un percorso che va da funzioni regolatorie fino al Livello 3, e con ambienti di simulazione per accorciare i tempi di sviluppo. ZF parla di configurazioni ProAI che arrivano oltre 1.500 TOPS nella versione più spinta. Un numero che dimostra quanto si stia spostando il collo di bottiglia: non è più tanto la quantità di sensori, quanto la potenza di calcolo necessaria per elaborarli in tempo reale.

Con Hyundai Mobis, invece, l’accento è sull’architettura SDV “ready” per mercati emergenti e in crescita, a partire dall’India. L’intesa prevede co-sviluppo di soluzioni di guida e parcheggio basate su Snapdragon Ride Flex, e un lavoro più ampio su piattaforme integrate che combinano software standardizzato di Mobis e tecnologie Snapdragon per migliorare performance, efficienza e stabilità.

Google e Qualcomm: dal “Google built-in” allo sviluppo in cloud

Il salto di scenario, però, non è solo hardware. A CES 2026 Qualcomm ha messo in primo piano l’estensione della collaborazione con Google: l’obiettivo dichiarato è semplificare lo sviluppo delle auto basate sul software e accelerare l’adozione di esperienze “agentiche”, cioè assistenti capaci di agire tra app, preferenze e contesto. Nel pacchetto entra Gemini Enterprise for Automotive, presentato come evoluzione del precedente Automotive AI Agent, con un’architettura che miscela modelli a bordo e nel cloud per personalizzazione in tempo reale e nuove funzioni distribuite via aggiornamento.

Qui c’è un nervo scoperto dell’auto moderna: l’infotainment è spesso potente, ma gli update restano lenti e frammentati. Qualcomm e Google parlano di una piattaforma di riferimento “allineata” alle roadmap di Android Automotive (si cita Android 17) e di strumenti per rendere gli aggiornamenti più prevedibili, riducendo la frammentazione tra generazioni di SoC. Nello stesso annuncio compare anche lo sviluppo in cloud: la possibilità di lavorare su “virtual SoC” su Google Cloud per progettare e validare software senza avere subito l’hardware in mano.

Il punto, alla fine, è meno glamour del ray tracing visto in demo ma più decisivo: chi controlla la piattaforma cockpit controlla anche il ciclo di vita del software in auto. E in un’industria che promette aggiornamenti continui, quello è il vero vantaggio competitivo.